嘉宾|谢永康、忻舟、靳伟

文心一言的发布已经进入倒计时。在这个特殊的时间节点,InfoQ 接触到了百度 AI 中台的技术团队,试图了解将全面支持文心一言在产业快速落地的工程化能力具体是什么样子。

国外,OpenAI 宣布正式推出面向商业用户的 ChatGPT 和 Whisper 语音转文字模型 API,开发人员可以通过 API 将 ChatGPT 和 Whisper 模型集成到自己的应用程序和服务中。

国内,百度即将发布的文心一言已经与 400 余家企业正式达成战略合作。

大模型的出现让沉寂了许久的资本市场再度热闹起来,投资人们近期不是在排会、就是在项目投决会上,相关概念股同样涨幅可观。从脉脉上放出的 AIGC 相关岗位来看,互联网、电商、智能硬件等众多领域的大厂全力开抢相关人才,知名猎头 CGL 等公司挂出 10 万月薪岗位开始抢人。

冷静之下,本轮 AI 热潮与此前几轮呈现惊人的相似——热点迸发,资本涌入,创业公司层出不穷,最终由于缺乏规模化落地,或不了了之,或大幅亏损。曾经被资本认为至少有 1000 亿美元估值的格灵深瞳实际不到 50 亿,而“AI 四小龙”过去一年则饱受“长期亏损、造血能力不足”的质疑。

归根结底,AI 的规模化落地远不是某一项技术突破就能实现的,除算力、算法、数据外还需要大量工程性、过程性工作的加入。从数据采集、标注到模型训练、上线,任何一个环节出现问题都会影响最终的落地效果。

当新一轮的技术浪潮来袭,AI 工程化再次成为无法回避的问题。

那么为什么谈论了这么多年,AI 工程化依旧无法寻找到最佳解决方案?MLOps 是最优解吗?如果是,这套方法论具体如何落地?可以给产业带来哪些实际价值… 本文,InfoQ 采访了百度 AI 中台总监忻舟,百度 AI 中台产品架构师靳伟以及百度智能云主任架构师谢永康,试图探究上述问题的答案。

为什么谈论了那么多年,AI 工程化问题依旧无法解决?

虽然 AI 工程化问题谈论了多年,但一直没有很好解决。主要原因在于如下三点:首先,行业内部一直缺乏统一的规范,这就导致解决方案质量良莠不齐,而 AI 开发流程长且复杂,从数据采集、数据标注、模型训练、到应用,再到最后的数据回流和模型观察,任何一个环节没有规范都会出现问题。

其次是人才问题,过去,业内人工智能相关的研发人才相对稀缺,且多集中在头部互联网大厂,传统企业基本都还在做数字化和自动化转型相关的事情,还没走到智能化转型的阶段。最近几年,相关高校的人工智能学院建设成果显著,向社会输送了大批优秀人才,互联网公司的人才也开始外溢到传统企业,这让传统企业具备了向智能化转型的基础条件。

最后是企业内部多年积累下来的历史问题非常复杂,比如企业的一个人工智能平台所需要的数据需要从数十个系统获得,而这些系统的对接工作需要花费大量时间和精力,分属同一领域的不同企业的基础设施并不完全相同,简单复制粘贴是无法达到效果的。

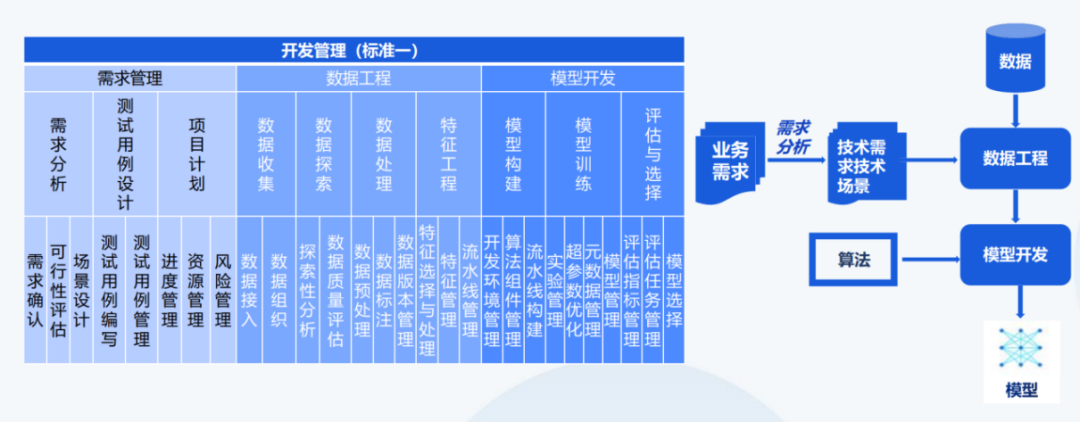

这其中最关键的就是行业标准的建立,一套完善的标准意味着在大部分领域通用的解决方案能力。过去一年,中国信息通信研究院为了更好地将互联网大厂的 AI 能力赋能产业,正式发布了《人工智能研发运营一体化 (Model/MLOps) 能力成熟度模型第一部分:开发管理》标准,百度智能云 AI 中台解决方案参与了 MLOps 开发管理服务能力评测,成为国内在开发管理能力上达到旗舰级的 MLOps 平台(面向产品方的最高等级)。

图注:MLOps 开发管理部分评测的指标体系涉及 28 个能力子项,考察点近 200 余项,是一个非常全面与系统的测评

简单来说,这套标准是首个汇集 AI 开发全流程的最佳实践宝典,可以帮助企业实现 AI 工程化落地,大幅提升 AI 研发和运营的质量和效率。那么,这样一套“旗舰级”的 AI 中台解决方案其具体架构是如何设计的?效果如何?能为产业带来哪些实际价值?

业内缺的不是 AI 中台,而是全周期端到端

MLOps(Machine Learning Operations)是一套面向机器学习项目和研发运营管理体系,指在人工智能软件项目的研发和运营过程中统一和管理需求、开发、测试、集成、部署和运营等环节,实现模型持续训练、持续集成、持续交付、持续监控的快速迭代和有效衔接。

这套方法论其实早在 2015 年就诞生了,号称遵循此设计的“AI 中台”解决方案也不在少数,那为什么没解决问题呢?

因为大部分 AI 中台都只解决了“某一段”的问题,而百度智能云 AI 中台是少有的端到端的覆盖 AI 研发和运营全生命周期的解决方案。

2020 年,百度智能云将原有服务按照 MLOps 的过程整合为四大板块,分别是数据样本中心,专门做数据处理;开发中心,提供专业的开发平台;模型中心,将开发中心训练好的模型统一管理,方便后期评估;服务运行平台,将模型最终发布为一个在线服务或者端服务,这四大平台基本涵盖了 MLOps 全生命周期。

除此之外,百度智能云在“安全可控“上也提供了众多周边企业级管控服务,比如模型风险管理,可以记录从模型立项、模型研发、数据收集,模型训练到模型上线和下线全流程的所有数据及评估过程,问题出现后可以迅速定位到责任人。另外针对结果,百度提供了模型的可解释性,涉及训练可解释和预测可解释两部分。在训练过程,企业可以得到模型的具体训练方式以及哪些参数在发挥重要作用等信息;在预测过程,企业可以倒推到底是哪些数据或者决策路径内的链条导致最终的结果是 Yes,这对注重安全的企业而言至关重要。

图注:百度 AI 中台架构图

靳伟表示上述四大板块加管控服务就是百度智能云的 AI 中台解决方案。那么,这样一套全周期端到端的解决方案到底有哪些优势呢?

从实施路径来看,业内一般有两种实现方式:一是针对 AI 领域人才相对缺乏,自身 AI 能力尚未建设完成的企业,百度智能云可提供全套的解决方案。而不是如过去一样建一个 OCR、搞一个智能客服这样的单点创新,是通过端到端把企业内部的底层 AI 基础设施建好,未来才可能在此基础上实现更多创新。

二是具备一定研发实力的企业,聚焦在个性化 AI 研发能力的构建,大幅提升 AI 模型落地应用推广效率。在此情景下,基础的方案可能完全起不了作用,只有具备端到端能力的解决方案才能助力研发人员快速搭建出一套适合企业发展的方案。

从最终效果来看,百度 AI 中台从需求和代码管理、AI 模型生产、底层计算资源管理、数据管理及质检全流程均完善的管理工具,能够为企业客户提供较为快速和较高质量的响应。

具体到单点功能上,其提供的自动标注能力相比于人工标注,成本平均降低 70%。特定场景下,数值远超于此。在资源利用率层面,模型训练本身是非常耗费 GPU 资源的,这在大模型时代尤为明显。整个过程涉及资源合理利用、资源调度、虚拟化以及提升 GPU 的利用率等,而 MLOps 对此有明确的规范,百度的 AI 中台基于这样的规范实现,可以给到用户更好地调度策略和虚拟化机制,确保资源利用率达到 80%,甚至 90%,这将为企业节省大量成本。

面向未来,百度的 AI 中台将与大数据平台实现深度联动。忻舟表示大数据和 AI 天生就应该在一起,MLOps 与 DataOps 的结合正在百度内部发生。未来,用户可以通过平台产品的方式直接获得这种能力,比如 AI 中台、大数据中台,也可以通过 SDK 的方式来获取相应能力,企业可以不用关心具体的实现方式,专注于与现有业务的具体结合。

当然,在产业智能化升级的过程中,仅靠 AI 中台显然是不够的,企业需要的是一个强悍的 AI 基础设施,可以解决智能化转型过程的一切问题。

强悍的不仅是 AI 大底座本身,而是烧钱也建不起的技术壁垒

百度 AI 中台与百舸异构计算平台两大部分共同构成了百度的 AI 大底座,形成了国内仅有的涵盖“芯片 - 框架 - 模型 - 应用”的 AI 生产全要素智能基础设施。

其中,百度 AI 中台整合了目前中国深度学习平台市场综合份额第一的“飞桨”和产业级知识增强大模型“文心大模型”,打通了百度的样本中心、模型中心、AI 开发平台、AI 服务运行平台,实现从数据存储到模型训练、生产、部署、测试的全链路、批量化生产;百舸异构计算平台整合了百度自研的 AI 芯片“昆仑芯”,可以提供高性价比的算力,承载海量数据的处理、超大模型的训练和推理。

百度是全球为数不多、进行全栈布局的人工智能公司,且各个层面都有关键自研技术,可以真正实现端到端优化,大幅提升效率。

图注:百度“AI 大底座”产品架构

以传统能源行业的智能化升级为例,电力企业最担心的两大问题:一是如何实现不同区域的电力资源按需调度,最终实现各区域的供需匹配,这个过程就要求员工 7x24 小时监控所有节点发回的电力信息;二是可以不受天气温度、地理位置的干扰对高压线缆进行巡检且保证员工安全,很多高压线缆处于深山密林中,巡检人员很难进去,并且巡检人员需要爬上线缆做各种各样的检查,非常危险。这对 AI 技术的应用也带来了实际挑战:一是电网企业硬件设备众多,数据、接口复杂,难以形成统一的感知和管理平台;二是模型开发难度高,电力设备分布在各种自然环境中,天气温度、地理位置等都会影响模型的最终效果,设备故障类型较多。

在国家电网的实际应用中,百度通过 AI 大底座的能力帮助国网实现了人工智能“两库一平台”的建设,促进了人工智能技术在输电、变电、配电、调度、电网企业营销、安全监察等各业务领域的落实、落地。并帮助国网福建建设了 AI 中台,在此基础上,协同打造电力大模型,构建了 AI 电力关键业务数据的全链条智能处理能力,实现需求、样本、模型、应用和迭代的全流程业务贯通,支撑国网福建电力更高效、规范地打造 AI 应用。目前,这一方法已帮助他们在识别准确率提升了 30%,识别效率提升了 5 倍。变电端效率提升了 40—60 倍,启动送电时间缩短了 80%。未来,通过 AI 大底座的全栈优势将持续为国网实现端到端优化模型效果,提供更高效能的服务。

但是,真正强悍的不仅仅是 AI 大底座本身,还有这背后的技术壁垒。

与云计算领域早期就拥有众多开源和标准化方案不同,构建 AI 能力所需要的数据、算法、算力以及工程化能力,每一环都具有极高的门槛,这也是 ChatGPT 带给我们巨大冲击之后,国内用户第一时间把注意力投到百度身上的原因,只有百度过去这么多年坚定不移地在 AI 研发上投入重金,并最早在产业里面实现了规模化落地。

当其他企业还受限于芯片研发技术和找不到场景打磨时,百度“昆仑芯”已上线数万片,广泛用在百度搜索和无人驾驶汽车、爱奇艺、小度等业务场景。

当其他企业还在纠结开源框架选型时,百度飞桨已经成长为一个自主可控的全栈平台,凝聚了数百万开发者,在产业里摸爬滚打四年多服务了数十万企事业单位。

当其他企业临时抱佛脚研究大模型时,百度文心大模型已经形成“模型层 + 工具与平台层 + 产品与社区层”的整体布局,成为业界规模最大的产业大模型体系。

作为一家既懂芯片,又懂算法,还有数据的企业,百度智能云可以根据用户实际场景的需要提供端到端的解决方案,在提供更优的客户体验的同时大幅降低成本,不是每一家搞 AI 的公司都恰好能拥有强大的云计算能力,也不是每一家搞云计算的企业都能与如此强悍的 AI 大底座形成有效协同。

一旦这套体系建立完成,云厂商将会在 AI 时代拥有极高壁垒。

碎片化生态的变革:从百度“AI 大底座”开始

过去多年,场景的碎片化带来了 AI 产品的碎片化,但也恰恰说明业内并没有一个通用、普适的人工智能产品出现,这里的原因很复杂,包括数据、算法、算力、生态建设等诸多方面。

百度 AI 大底座的出现让我们对打破这种“碎片化生态”重新燃起了希望。用户只需要提出诉求,平台就可以自动输出需要的结果,这就像一条流水线一样易用、顺畅。只有这样的解决方案才可能真正实现“AI 普惠”的未来愿景。

“AI 普惠在百度智能云有两层含义,第一层含义是让企业以更低的门槛获得 AI 能力;第二个含义是以更高性价比的方式获得 AI 能力,百度在做很多通用的 AI 平台型产品和针对特定场景的解决方案,以期通过最具性价比的方式解决企业问题,最终实现 AI 普惠。” 百度集团执行副总裁、百度智能云事业群总裁沈抖也在此前谈到:“需要云计算厂商标准化地输出智能化的底层能力,把芯片、大模型、深度学习框架等高门槛的技术,变成像水电能一样供客户按需取用。”