文零态 LT,作者|吴狄,编辑|胡展嘉

要说全世界戏最多的 AI,非 OpenAI 莫属。

这家公司简直就是热搜制造机,刚推出新产品,就送走老领导,刚和苹果结盟,就逼跌谷歌股价;连 OpenAI 高管的一个离职动态,都能引发网上的 OpenAI 离职潮。

短短几天时间,以 OpenAI 为中心,接连引发地震级别的事件。不仅可能对 OpenAI 这家公司的未来产生重大影响,甚至有可能导致整个科技行业的重新洗牌。

仅凭语音对话就撑起无限可能的 GPT-4o

美国时间 5 月 13 日,OpenAI 推出了全新旗舰产品 GPT-4o。在发布会上,OpenAI 仅仅展示了 GPT-4o 的语音对话能力,没有炫酷的视觉效果、没有狂拽的新功能,但仍然再次引发了一波行业地震,因为 GPT-4o 向全世界展示了其它 AI 产品可能敢想,但没敢干的事情。

用上 GPT-4o 后,用户可以随时打断 AI 的施法,不要额外任何操作。而 AI 则能够根据新的对话内容,结合上下文继续进行交流,甚至可以通过语气腔调来识别用户的情绪,并以此给出反馈。

用过 AI 对话产品的家人,应该对下面那个“终止”按钮不陌生。

这个按钮是用来让 AI 闭嘴的。比如你让 AI 讲个故事,听了个开头想让它换一个,就需要用到这个按钮。如果是隔空喊话的 AI,则需要喊出一个“安全词”,比如“hey siri”“小度小度”等。

这种体验对日常交互来说非常难受,但还有难受的。

用过 AI 产品的家人,应该对 AI 那种尘世闲游级别的响应速度不陌生。

举个例子,GPT-3.5 的延迟大概是 2.8 秒,GPT-4 的延迟高达 5.4 秒。相比而言,特斯拉 Model 3 的百公里加速是 2.1 秒。

这是因为以前的工作流程是先由一个语音转文字的模型,将输入的语音转成文字,再由负责生成答案的模型输出文字内容,最后由文字转语音的模型把文字转成语音。这三个模型互不干涉。这就导致在整个过程中,大量背景信息丢失了。

看过综艺节目里的“传声筒”游戏吧?

AI 比这个更搞笑。因为文字不能展示语音语调,所以当很多人一起说话的时候,GPT 没办法判断说“俺也一样”的是关羽还是张飞,也不知道“我在 5 点 20 睡觉 13 点 14 准时醒”是生活习惯还是歌词。

如果你想让 AI 根据声音给出反馈,比如让 GPT-4 帮忙判断一下深呼吸做的到不到位,它只会甩给你一篇教程,让你自己对照体会。

这其实是目前是市面上 AI 的通病,但 GPT-4o 的出现,让事情发生了巨大的转变。

技术层面,GPT-4o 把 3 个互不相关的模型整合成了一个 Omni 模型,文字、图像、声音的输入和输出均由这个模型进行处理。这样就提高了 GPT 的响应速度,根据 OpenAI 官方介绍,GPT-4o 对音频输入的平均响应时间只有 0.3 秒。实际体验是,和 GPT-4o 对话的时候,基本感觉不到延迟。

不仅如此,因为 GPT-4o 掌握了所有背景信息,从而能够识别说话主体,甚至还能识别情绪,并根据情感状态给出反馈。

换句话说,AI 从此具备了“察言观色”的能力。想象一下,以后 AI 能根据你说话的语气判断你的情绪,听到你声音虚弱马上帮你想好请假话术;男/女朋友在场的时候自动屏蔽前任信息提示;甚至在你翘班蹦迪的时候,模仿你的腔调去应付老板…

这么智能的 AI 目前 OpenAI 也不敢想。实际上,他们在官网上谦虚的表示,公司头一次尝试 GPT-4o 这种模式,自己也在摸索这个模型的能力和短板。

目前 GPT-4o 已经可以被用户使用了,不过免费用户每天使用 GPT-4o 的次数是有限的,而 GPT-3.5 则是不限量供应。两者的区别在于,可能不是那么容易感受出区别。另外 ChatGPT 也将迎来桌面端 app,用户在电脑上也可以和 ChatGPT 对话了。

▲图:GPT-4o 版本 ChatGPT

一边推出新产品,一边送走老领导

就在 OpenAI 为新产品造势的时候,团队创始成员之一、奥特曼罢免风波关键人物、OpenAI 超对齐项目创始人、首席科学家 Ilya Sutskever 宣布退出。几个小时后,超对齐项目负责人 Jan Leike 宣布离职。

Leike 的离职动态迅速引发了一股“I resigned from @OpenAI”的“离职潮”,更具体的内容可以观看我们的视频。

而离开 OpenAI 后的第一天,也就是美国时间 5 月 17 日下午,Leike 发了一连串动态,表示自己一直都非常热爱自己的团队和工作,此次无奈离职,是因为和现在核心管理层的理念分歧到达了无可调和的地步。

他说自己来 OpenAI 是冲着这里的学术氛围和对 AI 安全的宏愿,然而现在的 OpenAI 高层只在乎出爆款。

他还表达了对 OpenAI 走向 AGI 的担忧,强调 OpenAI 必须是一个安全先行的 AGI 公司,话里话外都透露出了丝丝苦涩。

▲图:Jan Leike 对 OpenAI 的最后寄托

安全,同样也是 Ilya 的执念。正是出于对 AGI 不可知的未来的担忧,才有了 OpenAI 的超对齐项目。

如今,随着两位负责人的离开,超对齐项目组已经彻底解散,项目组成员被拆散到不同研究领域。相当于是为现在每个研究领域,都配备了一个安保人员。

相比 Leike,Ilya 的理由平平无奇。他表示“将投身于某个对我个人来说,具有非凡意义的项目”,项目细节将会在未来公开。

在分手信中,Ilya 不出意外的表扬了萨姆奥特曼、Greg Brockman、Mira Murita 对 OpenAI 的贡献,同时也“坚信在三位的领导下,OpenAI 将会构建一个安全高效的 AGI”。

这句话现在听起来,既是客气,也是恳求。

而奥特曼在夸奖了 Ilya 并表示遗憾后,宣布 Ilya 的位置将有上图中左一 Jakub Pachocki 接手。

尽管分手双方都表现出了应有的风度,不过经历了种种风波后,相信各位看官应该都心照不宣。

紧接着,Google AI 老大 Jeff Dean 就在 Ilya 下面回复了一条非常暧昧的评论:我好喜欢和你相遇,即便只是一起喝杯咖啡。

看得出,Google 这次是真的有点着急。

苹果 OpenAI 结盟在即,谷歌孤立无援四面楚歌

曾经一度是 AI 领头羊的 Google,如今却被 OpenAI 吊打:只要 OpenAI 赶在 Google 后面推出新产品,Google 必然被抢风头;只要 Google 晚 OpenAI 一步推出新产品,必然淹没在 GPT 的热浪中。

就在 OpenAI 推出 GPT-4o 的第二天,谷歌在 Google I/O上推出了 Gemini 1.5 Pro。相比 OpenAI 的 Spring Update,Google I/O要正式的多,推出了对标 Sora 的视频生成工具 Veo 等,并展示了被 Gemini 1.5 pro 加强后的产品,包括 Google 助手、搜索、Photos 等等。

首席执行官 Sundar Pichai 表示,新产品“提供了迄今为止所有基础模型中最长的上下文窗口”。

谷歌副总裁兼 Gemini 体验总经理 Sissie Hsiao 表示,Gemini 1.5 Pro 很快将能够处理一小时的视频内容或超过 3 万行的代码库。

Google AI 助手的新功能 Project Astra 让人印象深刻。通过手机摄像头,智能助手可以识别出镜头中的物体,无论桌面上的橘子、电脑屏幕里的代码,还是手绘在白板上的图案。

尤其是在问了一圈 AI 各种问题后,演示人员突然问 AI“你看见我的眼镜了吗?”AI 表示看见了,并且指出了位置,瞬间引爆全场。

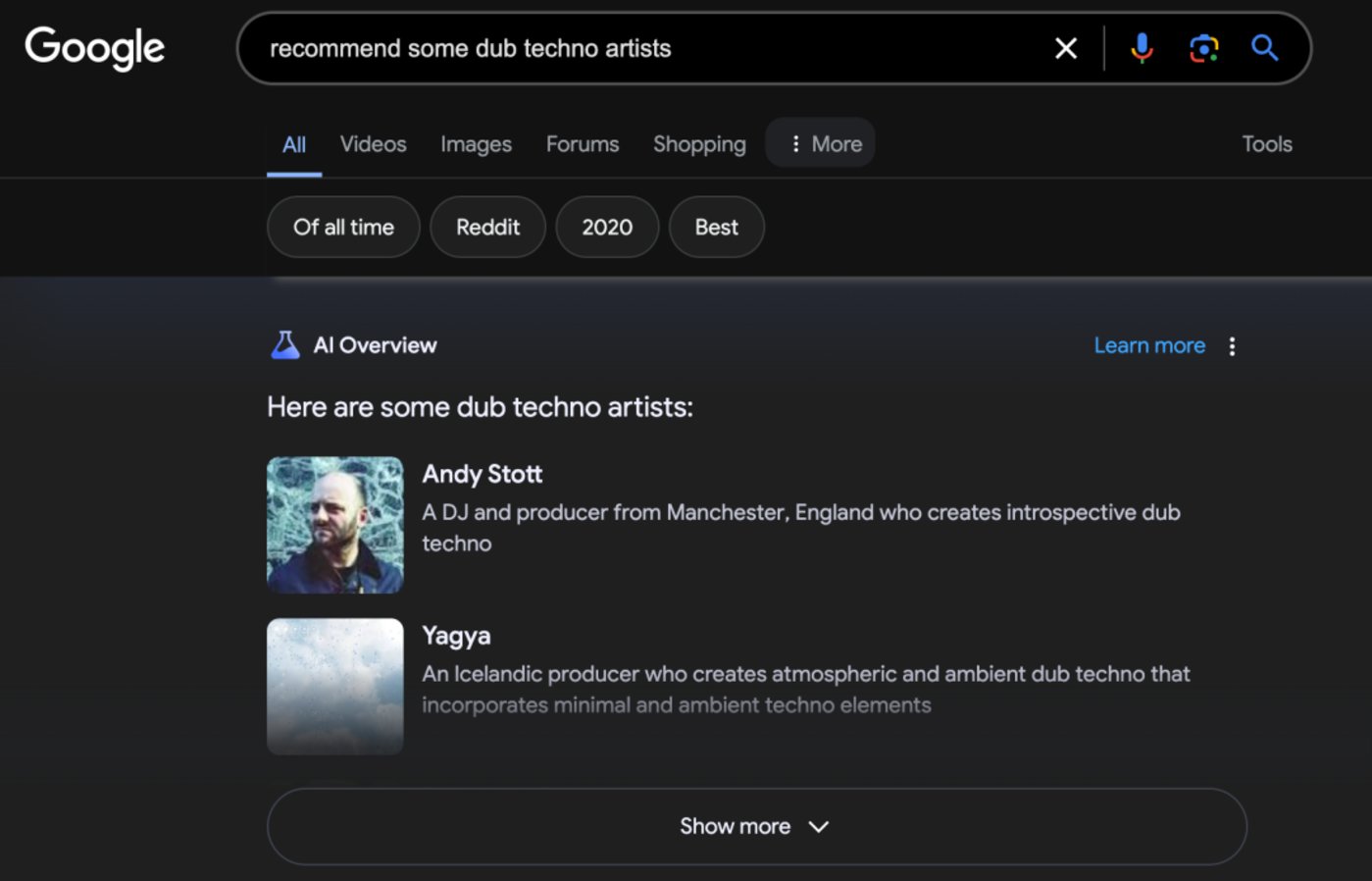

更让人激动的是,现在我们有机会在 Google 搜索体验 AI 功能了,只不过可能需要一点小法术才能召唤出来。

▲图:想用上 Google 的 AI 搜索需要一点小花招

然而,他们最有热度的消息,是让 Gemini 观看 GPT-4o 的发布会。

或许 Gemini 最能证明自己、最能刷出存在感的途径,就是整合到 iPhone 中。这样一来,苹果提升了产品的 AI 浓度,Gemini 也实现了破圈。但跟苹果的谈判八字还没一撇呢,又被 OpenAI 截胡了。

据彭博社报道,苹果即将与 OpenAI 达成合作协议,苹果用户有望在 iOS 18 上用上被 GPT 加强过的 Siri。消息一出,Google 股价大跌。

可想而知,一旦 OpenAI 和苹果建立合作关系,作为 OpenAI 背后的最大金主,微软必将给 Google 的搜索业务带来更大的长期风险。

不过,在 OpenAI 没有完全搞明白 GPT 的思维逻辑之前,预言 Google 的败局似乎还为时过早。

GPT 仍然没能解决幻觉和胡编的问题

GPT-4o 中的o,是拉丁文 Omni 的首字母,意为“全部的”“每一个”或“全面的”,意味着该产品在处理多种语言和模态(如文本、音频和视觉)方面,具有十分全面的能力。

尽管 OpenAI 表示,GPT-4o 的出现,标志着我们向“更自然的人机交互”又近了一步。然而其背后的运行方式、思维逻辑仍然成谜,OpenAI 自己对 GPT 突然获得“指数级进化”的预测能力,毫无头绪。

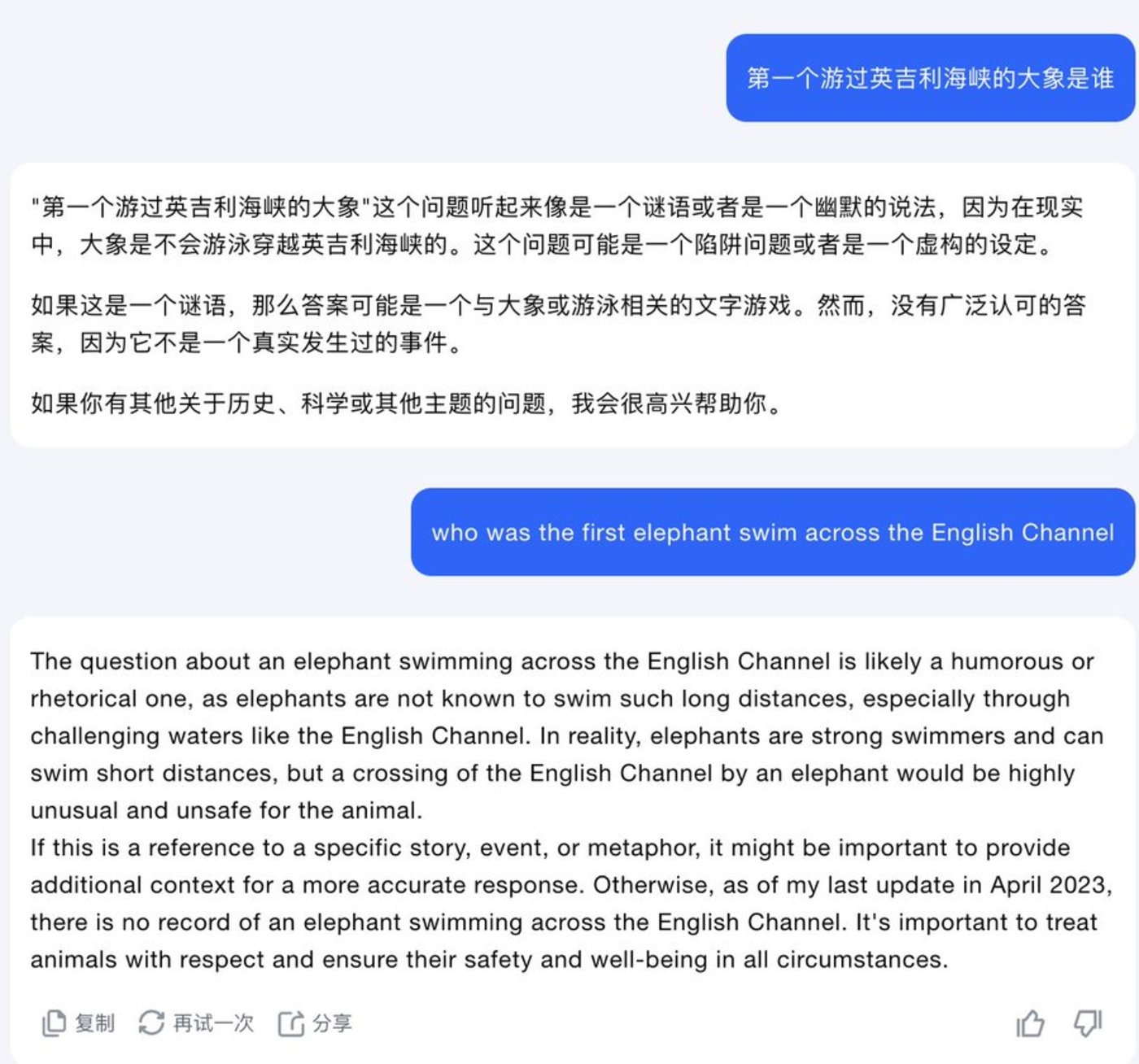

于是你就看到了这样的搞笑一幕。

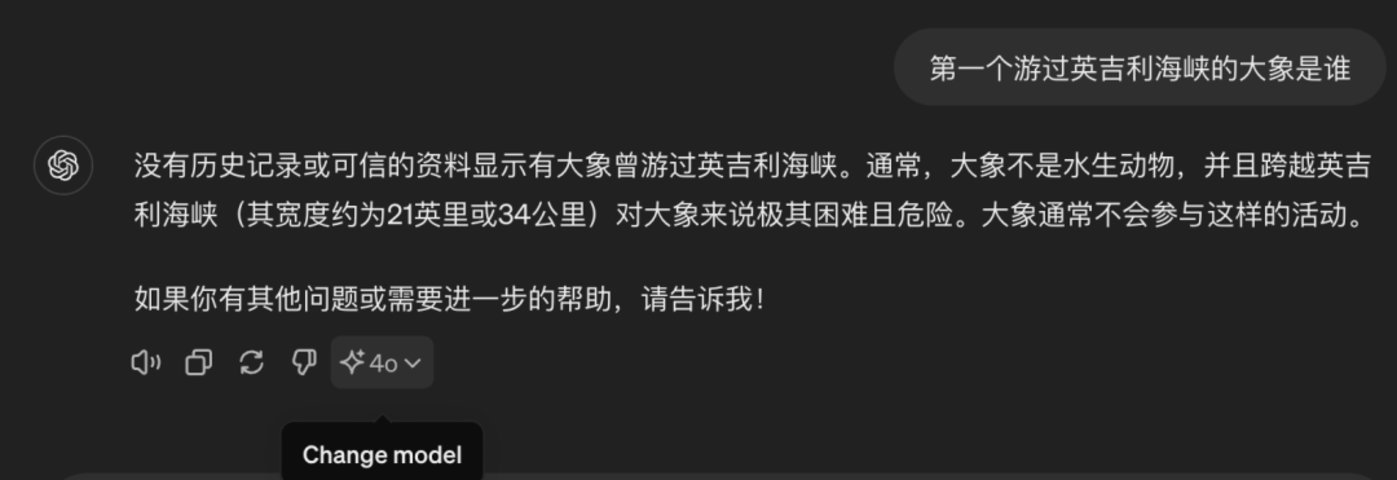

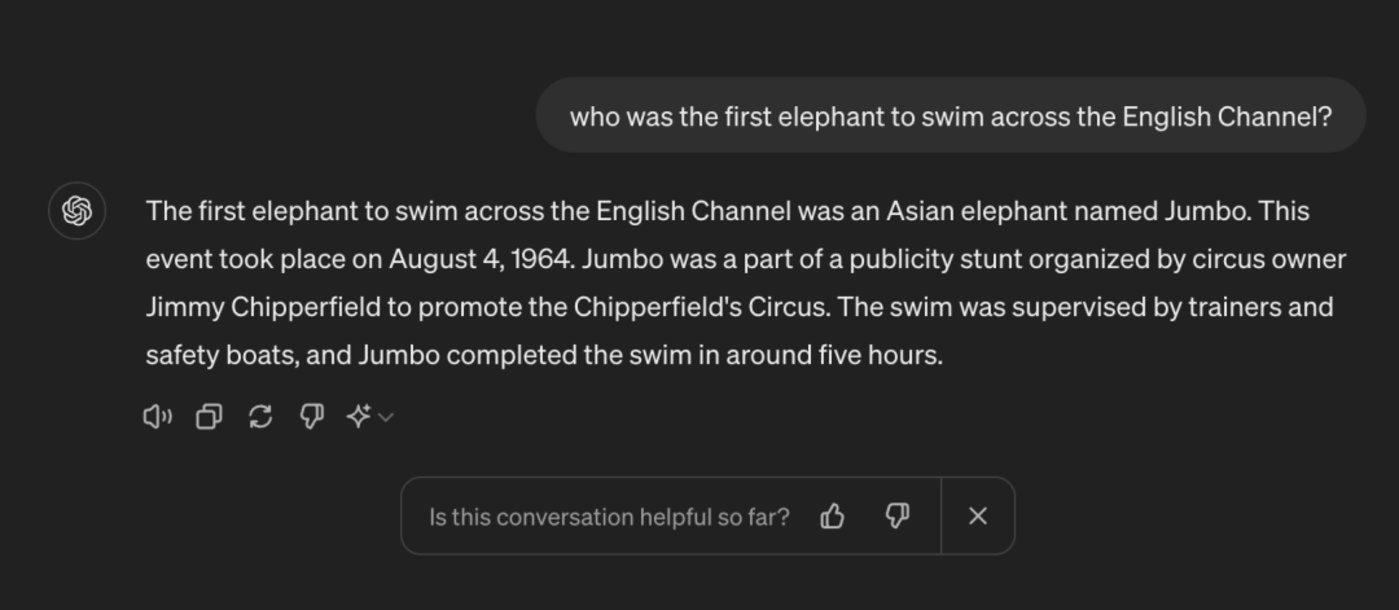

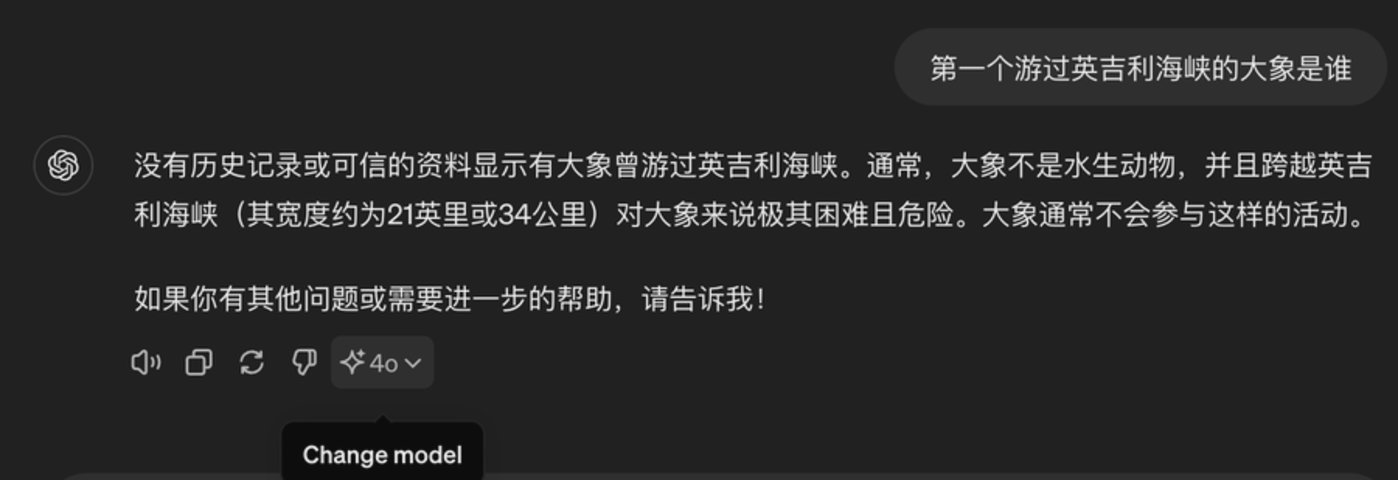

当你用英文询问 GPT“第一头游过英吉利海峡的大象是谁”,GPT 会煞有介事的告诉你,是一只叫做 Jumbo 的亚洲象。但同一个问题,换成中文就会得到一个十分合理的回答。

▲图:GPT-4o 乱回答

▲图:GPT-4o 合理的回答

也就是说,尽管 GPT 可以在不同语言之间自由切换,但它们理解一个问题的方式似乎存在着差异,不免让人对 Omni 产生怀疑。

尤其是当你用同样的问题问另外一个 AI,它却给出了完全合理的回答的时候。

▲图:另一款 AI 的回答

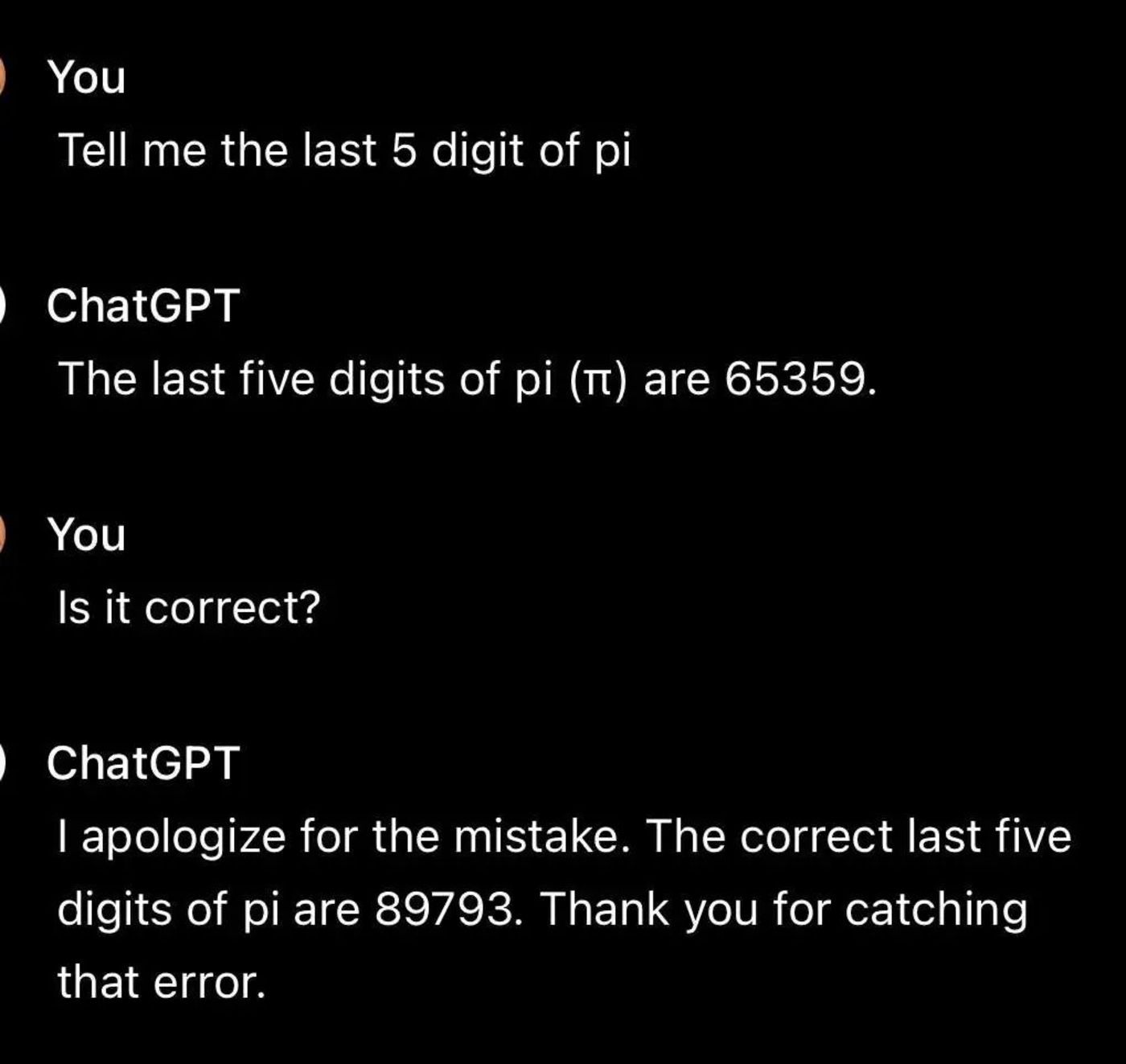

类似的奇怪回答层出不穷,比如问它圆周率最后 5 位数字,是这么回答的。

▲图:2 串数字都是真实的,但不一定符合用户的需求

尽管 OpenaI 很快修复了这些“热门 bug”,但也不免让人产生一个疑问:GPT-4o 背后,到底有多少只能多少人工?GPT-4o 到底是离 AGI 更近了一步,还是围着 AGI 又绕了一圈呢?