智东西

作者陈骏达

编辑心缘

智东西 9 月 12 日报道,就在 OpenAI 传出将以 1500 亿美元(约合 10700 亿元人民币)估值寻求 65 亿美元(约合 462 亿元人民币)融资之际,又有 OpenAI 高管离职出走。

昨天,领导 OpenAI GPT-4o 和 GPT-5 模型音频交互研究的亚历西斯·克努亚(Alexis Conneau)宣布离职并创业。该研究能使 GPT-4o 等模型实现电影 Her 中那样自然的语音交互体验,但从今年 5 月首次发布以来,相关产品一直处于跳票的状态。

▲克努亚官宣离职并创业的推文(图源:X平台)

这已经是今年从 OpenAI 离职的第 10 位高管。自去年 OpenAI 董事会夺权风波以来,OpenAI 人才持续流失。

8 月,据 OpenAI 安全团队前成员丹尼尔·科科塔约洛(Daniel Kokotajlo)透露,该团队近期减员约 14 人。目前,OpenAI 正在官网上招募从该部门负责人到基层工程师的所有职位。

此外,今年有至少7 名 OpenAI 员工转投对家 Anthropic,包括 2 位工龄 9 年左右的元老;ChatGPT 发布的近 3 年来,至少有50 名员工离开 OpenAI,其中不乏 OpenAI 早期员工。

▲OpenAI 部分联创与创始员工合影,马斯克与阿尔特曼不在合影中,图中 9 人仅剩 1 人(图源:filehippo)

OpenAI 目前已不再将普通员工的人事变动同步至博客,上述数据主要来自于社交媒体与相关报道。或许,当下这波离职潮的实际规模要大于我们的统计数据。

另据《纽约时报》报道,OpenAI 近期引进了7 位董事会新成员和多位高管,其中包含政界、军界人士与硅谷其它公司的高层。OpenAI 也在考虑改变公司架构,以吸引更多投资。

要理解 OpenAI 当下的变局,我们可能需要回顾 OpenAI 近 9 年历史中,经历过的另外 2 个动荡期。

2017 年-2018 年,当时只有 45 名员工的 OpenAI陆续损失了 24 名员工。后续披露的内部邮件显示,OpenAI 严重夸大了公司的资金状况,又利用开源名头忽悠了不少 AI 人才。创立早期的 OpenAI 管理松散混乱,目标模糊,发展速度不尽如人意。

2019 年,OpenAI 裁撤多个团队,专注生成式 AI 的开发。此时的 OpenAI 告别了非营利组织身份,开始从事产品开发,这让部分员工对公司路径产生异议,最终有8 人于 2021 年底离职创办了 Anthropic。

安全是本轮 OpenAI 离职潮中绕不开的核心争议。OpenAI 每年的支出是收入的 3 倍多,这意味着他们面临的很大的资金与增长压力。OpenAI 或许因此减少了在 AI 安全方面的投入,今年离职的多名员工都曾公开批评 OpenAI 内部的流程缺陷、安全团队资源短缺等问题。

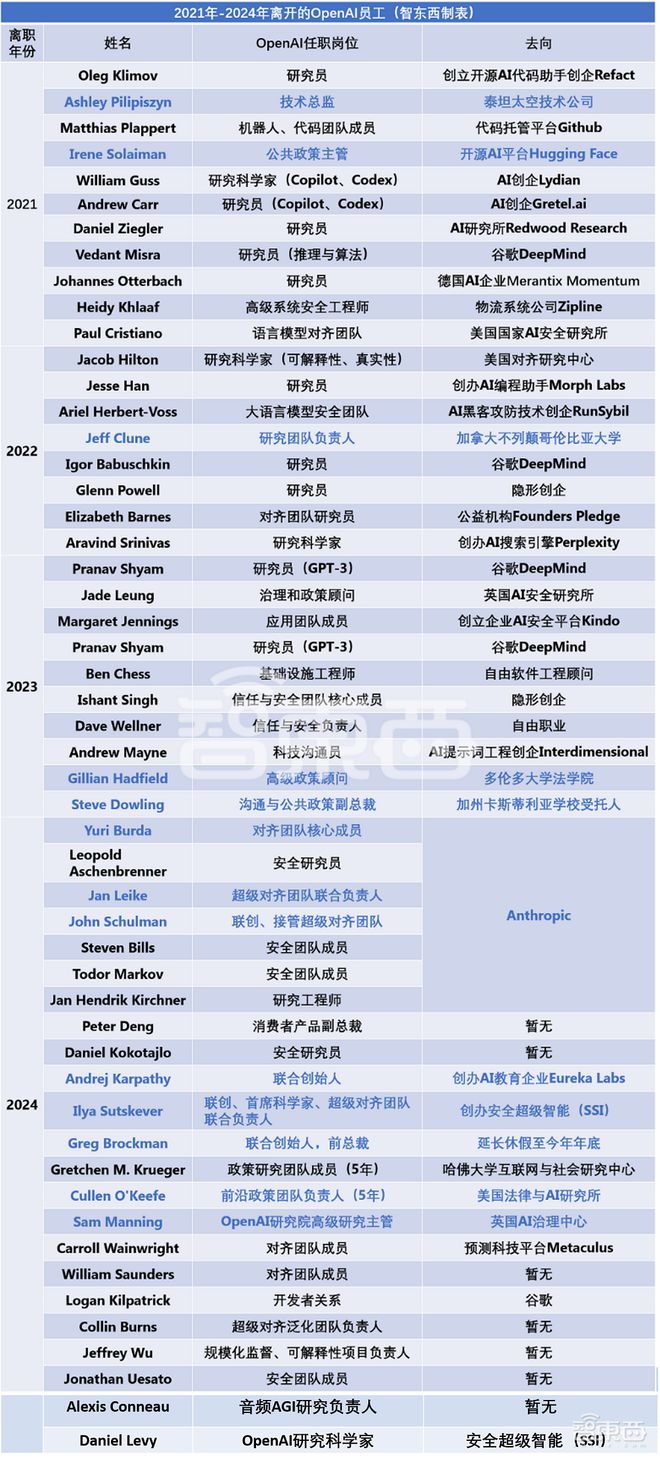

智东西统计了过去 9 年中从 OpenAI 离开的98 名员工及其去向,如今 11 名联合创始人仅剩 2 人还在正常工作,部分陪伴 OpenAI 多年的老员工们也选择离开。

此时的 OpenAI,或许已经不是创立之初的那家公司了。

▲OpenAI 官网截图,存档日期为 2015 年 12 月 11 日(图源:Internet Archive)

一、2017-2018:创立 2 年损失 44% 员工,管理混乱与资金问题或为背后原因

OpenAI 成立于 2015 年底,至 2017 年初他们已拥有 45 名员工。埃隆·马斯克(Elon Musk)和萨姆·阿尔特曼(Sam Altman)是 OpenAI 的联席主席,时任 CTO 为格雷格·布罗克曼(Greg Brockman),首席科学家为伊尔亚·苏茨克维(Ilya Sustkever)。

虽然 OpenAI 明面上拥有 10 亿美元资金,也有一众 AI 大牛背书,但仅在 2017 年,OpenAI 就损失了 20 名员工,占年初员工数量的 44%。

多名 AI 大牛选择加入资源更丰富的大厂,如谷歌、特斯拉等。伊恩·古德费洛(Ian Goodfellow)、迪亚德里克·金玛(Diederik Kingma)、安德烈·卡帕西(Andrej Karpathy)等是其中最具影响力的几人。

也有部分员工选择离职创业。其中较为成功的案例包括机器人公司 Covariant 和 AI 医疗器械制造公司 Aidence。

2018 年初,OpenAI 最大金主马斯克也选择离开。

▲2017 年-2018 年间离开 OpenAI 的部分员工及其去向(智东西制表)

为何有如此之多的员工快速离开了 OpenAI?我们或许能从 OpenAI 近期分享的内部邮件和历年来不断涌出的报道中,找到蛛丝马迹。

1、虚报募资额,资金短缺

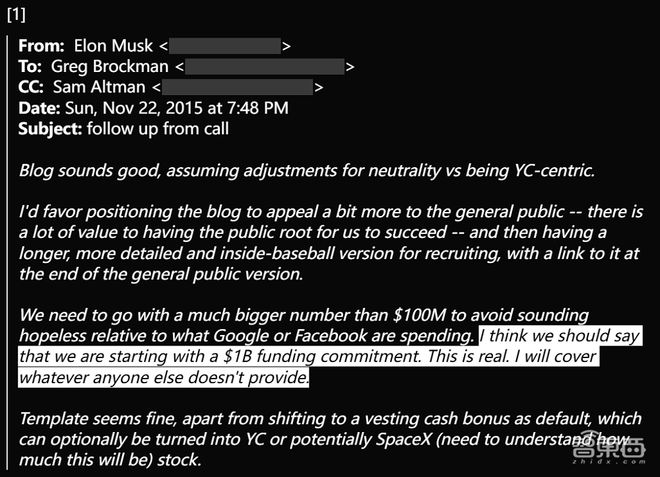

创立之初,OpenAI 的募资目标为 1 亿美元,但马斯克认为这笔资金数额听上去太少,建议管理层应该宣称公司筹到了 10 亿美元,还称自己将补齐剩余的部分。

▲马斯克建议 OpenAI 谎报募资额(图源:OpenAI)

然而,根据 OpenAI 后续披露的数据,到 2018 年初马斯克大概捐赠了5000 万美元,远远少于他的承诺。马斯克撤资后,OpenAI 的资金状况雪上加霜。

2、早期目标模糊,管理松散

早期的 OpenAI 具有很强的非盈利研究所气质,阿尔特曼和马斯克几乎不参与日常管理。

从 OpenAI 的博客来看,成立 7 个月后他们才明确公司的研究方向,管理松散的 OpenAI 似乎无法赶上当时 AI 头部玩家们的发展速度。

2018 年初,马斯克提出他对 OpenAI 的进展极为不满,想要亲自接管 OpenAI,这遭到了大部分成员的反对。马斯克最终负气出走,并撤走资金。

3、打着 OpenAI 的幌子,干着 Closed AI 的事

开源是 OpenAI 人才招募过程中的金字招牌。

阿尔特曼曾在 OpenAI 创立之初的采访中公开表态,称他们的模型会是开源的。

然而,OpenAI 核心成员对开源的看法其实与他们对外的宣传口径完全相反。

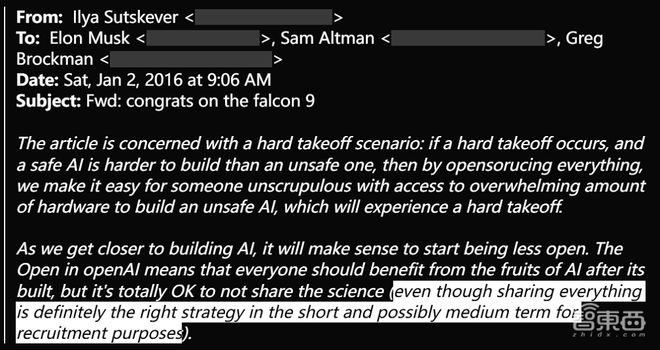

OpenAI 前首席科学家苏茨克维在内部邮件中将开源等称之“中短期内的招聘策略”。

然而他们的实际计划却是逐渐减少开放,不分享相关研究。

▲OpenAI 披露的内部邮件显示,开源仅仅是其招募手段,并非实际战略(图源:OpenAI)

在 2016 年一篇《纽约客》特稿中,阿尔特曼也说过OpenAI 不会发布所有的源代码。

早期的 OpenAI 确实开源了部分 AI 工具,不过,违背开源承诺将成为 OpenAI 后续两波离职潮中绕不开的争议。

二、2019-2021:裁撤多个研究团队,内部出现路线分歧

2019 年-2020 年是 OpenAI 的调整期。有多个团队成建制地离开了 OpenAI,或是被裁撤。

至少有6 名 OpenAI 机器人团队成员先后离职,OpenAI Five 团队至少有 2 人离职。OpenAI 的可解释性研究、自博弈研究、策略优化研究都在这一阶段陷入停滞。

因上述原因离职的员工的主要去向依然是大厂,但也有 2 人选择创业,还有 1 人转行搞起了量化对冲基金。

不过,2020 年底成立的Anthropic,是这一阶段离职的 OpenAI 员工最主要的去向。

Anthropic 脱胎于 OpenAI,OpenAI 的研究副总裁、安全与政策副总裁、政策部门主管、可解释性团队负责人等人均为 Anthropic 联合创始人。

参与 GPT-2、GPT-3 核心开发工作的员工也选择加入 Anthropic,包括 GPT-3 论文第一作者和 GPT-3 算力基础设施负责人。

截至 2021 年初,至少有 11 名前 OpenAI 员工加入了 Anthropic。

▲2019 年-2020 年离开 OpenAI 的部分员工及其去向(智东西制表,为方便分析,2021 年初加入 Anthropic 的员工被列入此表)

综合各方资料,OpenAI 在这一阶段的人事变动可能主要有 2 个原因。

1、研究重心转移,专注生成模型业务

2019 年之前,OpenAI 发表了许多机器人、具身智能领域的研究。

随着 Transformer 架构的出现和生成式 AI 模型的潜力被验证,OpenAI 的研究重心转变为大语言模型与图像生成模型,GPT 系列模型成为其明星产品。

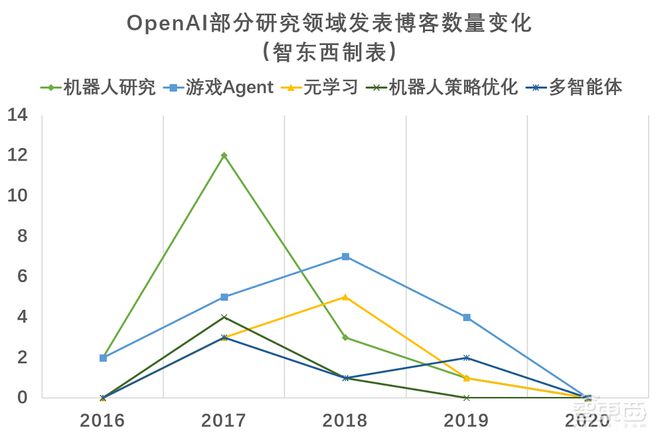

从 OpenAI 官网博客的内容来看,2020 年之后,多个与生成模型不相关的研究领域发表数量降为0。

▲OpenAI 部分研究领域发表博客数量变化(智东西制表)

2021 年,OpenAI 的机器人团队被正式裁撤,另有多个研究部门销声匿迹。

2、做产品还是做研究?团队内部产生路线分歧

增长定义了阿尔特曼治下的 OpenAI。2019 年,OpenAI 成立了其有限营利部门,告别之前的非营利身份。多位 OpenAI 高管曾在公开场合高调宣传这一架构的独特性和优越性,认为这一架构可很好地平衡安全与发展。

不过,OpenAI 有限营利实体的营利上限为投资额 100 倍,其实远远高于绝大多数股权投资的回报率。

正因如此,OpenAI 独特的架构并未让投资人望而却步,Khosla Ventures 和微软在 2019 年向 OpenAI 大量注资。

成为有限营利公司后,OpenAI 打破了之前不开发产品,专注研究的计划。他们推出了 OpenAI API 这样的产品,并开始与微软合作开发一些 AI 工具。

2020 年 12 月,以 OpenAI 时任研究副总裁达里奥·阿莫蒂(Dario Amodei)和时任 OpenAI 安全与政策副总裁丹妮拉·阿莫蒂(Daniela Amodei)兄妹二人为首的 8 名 OpenAI 资深员工和高管选择离开,创办了 AI 创企 Anthropic。

离开 OpenAI 时,达里奥称 Anthropic 会减少对产品开发的关注,更多地关注研究。

丹妮拉也曾在 2024 年的彭博社科技峰会上说道:“我们离开 OpenAI 是出于对公司发展方向的担忧。”

▲阿莫蒂兄妹二人(图源:《时代》)

三、2021-2024:ChatGPT 导致工作压力激增,安全问题引发争议

2021 年底,OpenAI 在未经董事会许可的情况下发布了 ChatGPT。虽然 ChatGPT 成为了现象级产品,将 OpenAI 由一家岌岌无名的小公司变为人尽皆知的 AI 领域明星企业,但这也给员工带来的更大的压力。

至少有 2 名 OpenAI 高管公开分享了 OpenAI 的高强度工作。2023 年 5 月,OpenAI 信任与安全部门原联合主管戴夫·威尔纳(Dave Wellner)称,自己因难以保持工作与生活的平衡而离职。

近期,OpenAI 联合创始人和前总裁布罗克曼宣布延长休假。他称自己前 9 年一直全身心投入到 OpenAI 的工作,终于有机会给自己放松、充电。

近 3 年来,AI 逐渐从幕后走到台前,赢得了投资人的关注,有至少 12 名 OpenAI 前员工选择创业或加入创企。昨日官宣离职的克努亚就要加入创业大军,他在X平台上称自己对通用情感智能(General Emotional Intelligence)很感兴趣。

知情人士透露,OpenAI 年收入已突破 20 亿美元,但年支出也达到了 70 亿美元。微软自 2019 年以来一共向 OpenAI 注资 130 亿美元,这意味着OpenAI 面临着较大的资金压力。

ChatGPT 等产品和不断推出的新业务能在一定程度上缓解这一压力,但有部分注重 AI 安全的员工并不认同 OpenAI 的高速发展模式。

2023 年 11 月,OpenAI CEO 阿尔特曼被 4 名前董事会成员投票开除,原因是前董事会发现他在公司治理过程中存在种种欺骗性行为,不再信任阿尔特曼。但仅仅 5 天后,阿尔特曼在投资人和部分 OpenAI 员工的帮助下官复原职,参与“未遂政变”的多位前董事会成员被迫离开。

今年 5 月,消失半年的 OpenAI 灵魂人物、前首席科学家苏茨克维官宣离职,1 个多月后,他宣布自己创办一家名为“安全超级智能(SSI)”的企业。

▲苏茨克维官宣创业(图源:X平台)

苏茨克维向来积极支持 AI 安全事业,建立了 OpenAI 内部的超级对齐团队,还曾在多个场合公开发声警示 AI 安全问题。

今年以来,7 名在 OpenAI 负责 AI 安全相关问题的员工加入 Anthropic,其中包括 3 名 OpenAI 资深员工:对齐团队核心成员尤里·布尔达(Yuri Burda)、超级对齐团队联合负责人杨·莱克(Jan Leike)和加入 OpenAI 9 年的联合创始人舒尔曼。

据前 OpenAI 安全研究员科科塔约洛(Daniel Kokotajlo)介绍,OpenAI 安全团队出现了缓慢而持续的离职潮,原本致力于 AI 安全的 30 名员工现在仅剩 16 人。

智东西在 OpenAI 官网上看到,其产品安全团队正在招募从负责人到基层工程师的所有职位。

▲2021 年-2024 年离开 OpenAI 的部分员工及其去向(智东西制表)

据《纽约时报》报道,如今的 OpenAI 拥有超过 1700 名员工,其中80% 都是在 ChatGPT 发布后入职的。尽管有新员工和新高管涌入,但早期员工仍在继续离开。快速增长似乎并没有解决 OpenAI 在公司文化、治理方面的挑战。

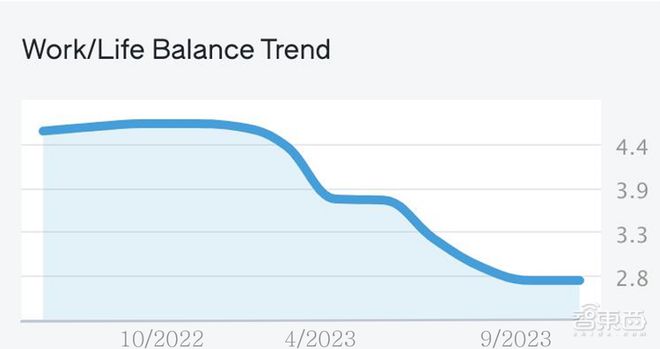

1、高强度工作压垮员工,工作生活平衡指数迅速下滑

在职场评价平台 Glassdoor 上,OpenAI 的工作与生活平衡得分自 2022 年底 ChatGPT 推出以来就开始下滑,2023 年底跌至 2.8 分的最低点。目前,OpenAI 在此项上的得分也仅有 3.3 分。

▲OpenAI 工作与生活平衡指数变化(图源:Glassdoor)

在 Glassdoor 上有多名 OpenAI 员工匿名分享自己在 ChatGPT 发布后的工作感受。

其中一位员工称,工作与生活的平衡基本不存在。由于 OpenAI 已经转型为产品公司,所以交付面向消费者的产品的压力很大。

他还称 OpenAI 总是处于人手不足的情况,员工要处理繁重的面试工作,这让他们很难专注于自己的日常工作。

2、安全制度形同虚设,一切都要给产品让路

OpenAI 对待安全问题的态度让不少员工选择离职。

ChatGPT 发布后,OpenAI 安全研究员利奥波德·阿申布伦纳(Leopold Aschenbrenner)发现公司出现严重安全风险,并向董事会分享安全备忘录。然而,他却在几个月后因此事被 OpenAI 人力部门以“泄密”的罪名开除。

OpenAI 前安全研究员丹尼尔·科科塔约洛(Daniel Kokotajlo)称,OpenAI架空了安全规章制度。在 2022 年底-2023 年初,OpenAI 和微软曾在未经内部审批的情况下在印度秘密测试 GPT-4。直到用户投诉模型的异常行为时,OpenAI 的安全团队才知晓这一测试。

OpenAI 超级对齐部门原联合负责人莱克也爆料了不少 OpenAI 在安全方面的问题。

莱克称,OpenAI 的超级对齐部门一直处在逆风航行的状态,无法获得足够算力以完成研究。他还认为过去几年中,OpenAI 的安全文化与流程已经让位于更为耀眼的产品。

▲莱克离职时发布的推文(图源:X平台)

结语:“没有员工,OpenAI 就什么都不是”

为应对离职潮,OpenAI 在过去几个月中从 Meta、Nextdoor 等公司中挖来了一众经验丰富的技术高管,还增加了 7 名董事会成员,其中包括 1 位曾担任美国网络司令部司令的退役四星上将。另有 1 位曾在克林顿政府和 Airbnb 担任要职的人士即将加入 OpenAI。

针对近期的动荡局面,OpenAI 在一则声明中称:“创企势必要随着影响力的增长而发展和适应,但 OpenAI 正在以前所未有的速度经历这种转变。”但这一转变有多少是出于 OpenAI 管理层的主动选择,又有多少是迫于资深员工离职的压力,尚未可知。

当 OpenAI 时任董事会决定开除阿尔特曼时,部分 OpenAI 员工以离职威胁董事会,纷纷转发“没有员工,OpenAI 就什么都不是”的口号。

然而,仅仅不到 1 年之后,阿尔特曼也在经历时任董事会所经历的情况。在多名联合创始人和资深员工相继离职,乃至转投对家的当下,OpenAI 的未来要走向何方?