华人学者、斯坦福大学副教授 James Zou

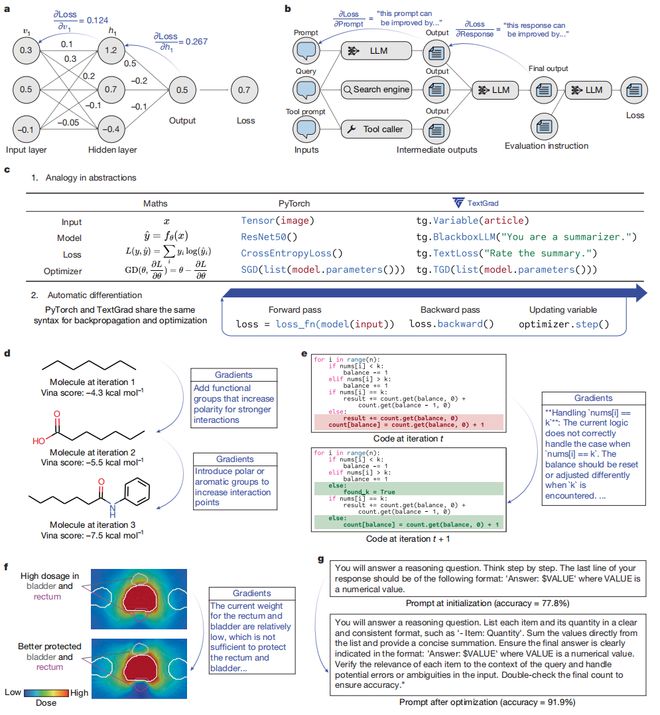

人工智能(AI)领域的突破越来越多地由协调多个大语言模型(LLM)和其他专业工具(如搜索引擎和模拟器)的系统驱动。迄今为止,这些系统主要由领域专家手工制作,并通过启发式方法进行调整,而不是自动优化。

人工神经网络的发展也面临着类似的挑战,直到反向传播和自动分化技术的出现,才使优化工作变得简单易行,从而改变了这一领域。

受此启发,华人学者、斯坦福大学副教授 James Zou 领导的团队提出了 TextGrad ,通过文本自动化“微分”反向传播大语言模型(LLM)文本反馈来优化 AI 系统。

只需几行代码,你就可以自动将用于分类数据的“逐步推理”提示转换为一个更复杂的、针对特定应用的提示。

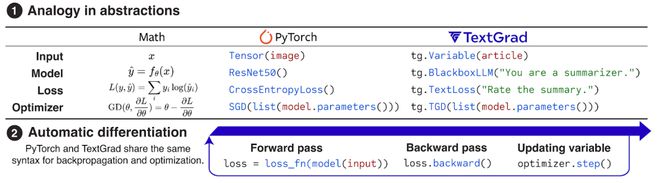

据介绍,TextGrad 是一个多功能框架,通过反向传播 LLM 生成的反馈来执行优化,从而改进人工智能系统。TextGrad 基于三个原则构建:

-

它是一个通用的高性能框架,并非为特定应用领域而手工打造;

-

易于使用,与 PyTorch 的抽象概念如出一辙,因此可以进行知识转移;

-

完全开源。

在 TextGrad 中,一切都是文本,使用语言模型评估输出、评论它们、更新输入。开发自动优化算法是利用 LLM 构建复合系统并加速未来突破的最关键挑战之一。利用自然语言反馈来批评,对系统的任何部分提出改进建议--从提示到输出,如分子或治疗方案等--TextGrad 能够在各种任务中自动优化生成式人工智能系统。

图|TextGrad 概述

相关研究论文以"Optimizing generative AI by backpropagating language model feedback"为题发表在权威科学期刊 Nature 上。

论文链接: https://www.nature.com/articles/s41586-025-08661-4

研究团队展示了如何在 GPQA(博士级问题解答)和 LeetCode Hard(高难度编程问题)中实现 SOTA 性能。

他们通过优化药物发现的分子来解决有影响力的科学问题,并通过优化治疗方案来改善患者的治疗效果。他们发现,无需修改框架,TextGrad 即可在许多领域发挥作用。

他们表示,TextGrad 可以帮助科学家和工程师轻松开发有影响力的生成式人工智能系统。

Textgrad:LLM 系统「缺失的一环」

Pytorch 是构建复杂神经网络最流行的框架,多年来,不同的原因使它获得成功,但其中一个原因是其语法的灵活性和“友好性”。

TextGrad 提供了一个遵循 PyTorch 语法的 API,允许用户通过使用仅由(可能不同的)语言模型提供的文本反馈来优化任何提示或结果。他们可以使用少量的示例数据将提示优化为语言模型。

此外,TextGrad 还允许语言模型自我完善其响应,评估由任何潜在的黑盒函数提供,例如语言模型本身或代码解释器的输出。

他们在解法优化、代码优化、推理提示优化、放疗计划优化、复合人工智能系统优化上进行了研究。

在解法优化中,解决方案优化目标 = LLM(问题 + 解决方案 + 测试时指令),优化的参数是解决方案,损失函数通过对解决方案的评估获得。在每次迭代中,LLM 都会收到问题、当前解决方案和测试时指令的提示,要求对当前迭代进行评判。

代码优化的目标是修改代码以提高其正确性或运行时的复杂性。通过有限的本地单元测试监督,并通过测试指令进行自我评估要求对当前的代码迭代进行判别。

在推理提示优化中,完善目标 = LLM(问题 + 代码 + 测试时指令 + 测试结果)。LLM 在推理任务中的表现对用于指导其行为的提示非常敏感。有了正确的提示,它们的推理能力就能得到显著提高。

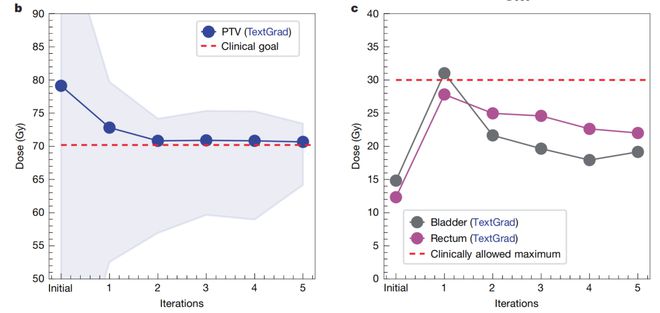

放射治疗是一种癌症治疗方法,它利用 X 射线等强能量束来杀死癌细胞。治疗前,放射肿瘤专家和规划师团队会合作设计有效的治疗方案,包括确定必要的放射治疗剂量,并精确定位需要治疗的部位。

TextGrad 在实现 PTV 区域临床目标方面的能力表现优于临床计划,实现了更高的平均剂量和与规定剂量完全一致的 D95,其中 D95 表示 95% 靶区/器官容积所接受的最小剂量。

TextGrad 通过迭代改进平均剂量并降低 PTV 的剂量方差,从而实现临床目标。

经过 TextGrad 优化的计划对这些健康器官的平均剂量较低,表明对器官的保护效果优于人类优化计划。

最后,他们还研究了 TextGrad 优化涉及多个变量和较长推理链的复合 AI 系统的能力。

以 Chameleon 系统为例,其原始静态执行流程易导致错误累积,TextGrad 通过迭代优化每个模块的输出(如规划、图像描述、知识检索等),反向传播文本反馈以修正中间推理步骤,最终在 ScienceQA-IMG 任务上实现 7.7% 的准确率提升。

此外,TextGrad 支持联合优化多模态任务的指令提示、解决方案及评估提示,在空间推理数据集 HQH 上将准确率提升 9%。实验表明,TextGrad 能够灵活处理多变量、长链推理的复杂系统,显著提升整体性能,为自动化优化多组件 AI 系统提供了通用框架。

曾获“诺奖风向标”斯隆奖学金

James Zou 本科毕业于杜克大学,并于哈佛大学取得博士学位,现为斯坦福大学生物医学数据科学副教授,曾获被称为“诺奖风向标”的斯隆奖学金。

他的研究工作主要聚焦于使机器学习更加可靠、符合人类需求以及统计严谨,同时也涉及 AI 在人类疾病和健康方面的应用。

2023 年 8 月,他和他的团队在 Nature Medicine 上发表论文,首次展示了利用 Twitter 上的数据,来开发“病理图像-文本对应”的自然语言-图像预训练模型。

2024 年 4 月,James Zou 在 Nature Machine Intelligence 上发表论文,他们推出了一个生成式 AI 模型 SyntheMol,该模型可以设计数十亿种新的抗生素分子,而这些分子价格低廉且易于在实验室中合成。

此外,James Zou 团队还构建了一个名为 Vitual Lab(虚拟实验室)的多智能体系统。该团队由一个 AI 模型作为首席研究员,并带领具有不同科学背景(如化学、计算机科学等)的 agent,团队里还有一名人类研究员提供反馈。人类科学家负责制定研究目标,为 agent 安排会议,允许它们相互讨论项目,通过多轮讨论提供规范的科学文本。

可以想象的是,随着人工智能的范式从训练单个模型转向优化涉及多个相互作用的 LLM 组件和工具的复合系统,自动优化器 TextGrad 将为训练大型复合 AI 模型开辟令人兴奋的机会。

作者:与可

如需转载或投稿,请直接在公众号内留言